OpenAI ha svelato una nuova famiglia di modelli di intelligenza artificiale denominata GPT-4.1, puntando decisamente sul miglioramento delle capacità di codifica e sull’ampliamento delle finestre di contesto. Secondo quanto riportato da TechCrunch e Inc., questa nuova generazione di modelli sarà disponibile esclusivamente attraverso l’API dell’azienda, segnando un importante passo avanti nelle capacità dell’intelligenza artificiale generativa.

Una famiglia di modelli specializzati nella codifica

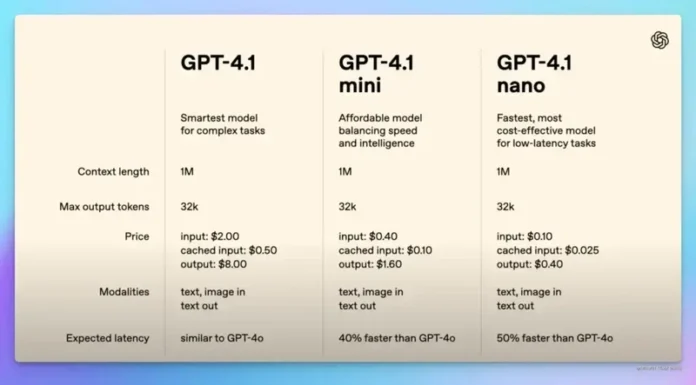

La nuova offerta di OpenAI include tre modelli distinti: GPT-4.1, GPT-4.1 mini e GPT-4.1 nano, ciascuno progettato per eccellere in compiti di programmazione e nel seguire istruzioni tecniche complesse. La strategia dell’azienda riflette un chiaro riposizionamento verso il mercato degli sviluppatori, con particolare attenzione alle esigenze di chi lavora quotidianamente con il codice.

Questa specializzazione rappresenta un’evoluzione significativa nella strategia di OpenAI, che sembra voler rispondere alle crescenti richieste del settore tecnologico di strumenti AI più performanti nell’ambito della programmazione. L’adozione di modelli specifici per la codifica potrebbe accelerare ulteriormente l’integrazione dell’intelligenza artificiale nei flussi di lavoro degli sviluppatori, con potenziali impatti rivoluzionari sulla produttività e sull’innovazione software.

GPT-4.1 Nano: potenza in formato compatto

Tra i nuovi modelli, GPT-4.1 nano si distingue come la soluzione più economica e veloce, progettata specificamente per sviluppatori che necessitano di bassa latenza senza compromettere eccessivamente le prestazioni. Nonostante le dimensioni ridotte, questo modello offre capacità sorprendenti:

- Una finestra di contesto completa di 1 milione di token, alla pari con i suoi “fratelli” maggiori

- Prestazioni che superano GPT-4o mini in diversi benchmark chiave

- Un prezzo particolarmente competitivo: $0,10 per milione di token in input e $0,40 per milione di token in output

Il modello nano eccelle in attività specializzate come la classificazione e il completamento automatico del codice, ottenendo risultati impressionanti nei benchmark tecnici: 80,1% su MMLU (Massive Multitask Language Understanding), 50,3% su GPQA (Generative Pre-training for Question Answering) e 9,8% su Aider polyglot coding.

Questa combinazione di prestazioni, velocità e costo ridotto potrebbe rendere GPT-4.1 nano particolarmente appetibile per startup e sviluppatori indipendenti, democratizzando l’accesso a strumenti di intelligenza artificiale avanzati per la programmazione.

La competizione con Google Gemini 2.5

Il lancio di GPT-4.1 avviene in un contesto di crescente competizione con Google, che ha recentemente rilasciato Gemini 2.5 Pro il 25 marzo 2025. Il confronto tra questi modelli rivela punti di forza e debolezze per entrambe le piattaforme.

Gemini 2.5 Pro vanta attualmente una finestra di contesto di 1 milione di token, con piani di espansione a 2 milioni nel prossimo futuro. Il modello di Google eccelle nelle capacità di ragionamento, ottenendo un impressionante 18,8% nel test “Humanity’s Last Exam”, e supera GPT-4.1 in matematica e nella gestione di contesti estesi.

Tuttavia, GPT-4.1 mantiene ancora un vantaggio significativo nell’accuratezza del fact-checking e nelle prestazioni di generazione del codice, sebbene con un margine ridotto rispetto alle versioni precedenti.

Le differenze più rilevanti tra i due concorrenti includono:

- Modello di accesso: Gemini 2.5 Pro offre accesso gratuito con limiti di utilizzo, mentre GPT-4.1 richiede un abbonamento a pagamento

- Specializzazione: Gemini 2.5 Pro dimostra prestazioni superiori nella generazione di applicazioni complete e nel debugging, mentre GPT-4.1 si concentra più specificamente su compiti di codifica mirati

- Capacità multimodali: entrambi i modelli supportano l’elaborazione multimodale, ma Gemini 2.5 Pro include anche elaborazione vocale e video più avanzate

Questa competizione sta accelerando l’innovazione nel settore, con benefici tangibili per gli sviluppatori che dispongono ora di strumenti sempre più sofisticati per la programmazione assistita dall’intelligenza artificiale.

La rivoluzione del contesto da 1 milione di token

L’elemento più rivoluzionario di tutti i nuovi modelli GPT-4.1 è senza dubbio la finestra di contesto da 1 milione di token, un salto quantico rispetto al precedente limite di 128.000 token dei modelli GPT-4o.

Per comprendere la portata di questo miglioramento, è sufficiente considerare che questa finestra di contesto consente ai modelli di elaborare l’equivalente di più di 8 copie complete dell’intero codice base di React in una singola richiesta. Una capacità che trasforma radicalmente le possibilità di utilizzo dell’AI in ambito professionale.

OpenAI ha specificamente addestrato la famiglia GPT-4.1 per utilizzare efficacemente questo contesto ampliato, migliorando la capacità dei modelli di:

- Individuare informazioni rilevanti in enormi volumi di testo

- Ignorare contenuti non pertinenti o distrazioni

- Mantenere coerenza e precisione anche in progetti di grandi dimensioni

- Recuperare dettagli specifici indipendentemente dalla loro posizione all’interno dell’input

Questi miglioramenti risultano particolarmente preziosi per applicazioni nei settori legale, della programmazione avanzata, del supporto clienti e in tutti quegli ambiti che richiedono l’elaborazione e l’analisi di documenti estesi o basi di codice complesse.

La capacità di gestire contesti così ampi rappresenta un passo significativo verso sistemi di intelligenza artificiale in grado di comprendere e manipolare informazioni su scala sempre più simile a quella umana, con implicazioni profonde per il futuro dello sviluppo software e della gestione della conoscenza.

Implicazioni per il futuro dello sviluppo software

Il rilascio della famiglia GPT-4.1 segna un’importante evoluzione nel panorama degli strumenti di sviluppo software assistiti dall’intelligenza artificiale. La focalizzazione sulla codifica e l’espansione massiccia della finestra di contesto potrebbero trasformare profondamente i flussi di lavoro degli sviluppatori nei prossimi anni.

Possiamo prevedere un’accelerazione nell’adozione di sistemi di pair programming con l’AI, dove i modelli GPT-4.1 fungono da collaboratori virtuali in grado di comprendere progetti software nella loro interezza, suggerire implementazioni, identificare bug e ottimizzare il codice in tempo reale.

La crescente competizione tra OpenAI e Google nel settore dell’AI per la codifica sta inoltre stimolando un rapido ciclo di innovazione che promette di rendere questi strumenti sempre più sofisticati e accessibili, con potenziali ricadute positive sulla produttività degli sviluppatori e sulla qualità del software prodotto.

Mentre il settore continua a evolversi, sarà interessante osservare come questi avanzamenti influenzeranno non solo il modo in cui il software viene sviluppato, ma anche il ruolo degli sviluppatori umani in un ecosistema sempre più supportato dall’intelligenza artificiale.